滚球app GRPO际遇瓶颈? G²RPO-A让自稳当率领为小模子推理身手「开外挂」

2026-05-07 14:54:23 142

大模子期间的「真金不怕火金术师」们,大致王人曾靠近一个共同的困扰:当咱们试图将 DeepSeek-R1、OpenAI-o1 那种惊艳的推理身手移动到小规模谈话模子(SLMs)时,效用却老是差强东谈宗旨。现存的强化学习关节如 GRPO 在 7B+ 的大模子上效用显赫,但一朝诳骗到 1.7B 甚而更小参数的模子上,性能擢升就蝇头小利。

针对小模子在强化学习中的推理逆境,香港中语大学(深圳)T-Lab 唐晓莹训诫携课题组博士毕业生郭永新、邓文博提议了全新算法 G²RPO-A(Guided Group Relative Policy Optimization with Adaptive Guidance)。已被 ACL 2026 主会议(Main Conference)接收。

该关节通过在 roll-out 经由中注入高质地想维轨迹,并字据磨真金不怕火景色动态调节率领强度,有用缓解小模子靠近的奖励疏淡问题。在 Llama、Qwen、DeepSeek 等多个主流模子家眷上的推行标明,G²RPO-A 在数学推理和代码生成任务上显赫优于 vanilla GRPO,其中 Qwen3-1.7B 在 MATH500 上从 50.96 擢升到 67.21,HumanEval 上从 46.08 擢升到 75.93。

论文地址:G²RPO-A: Guided Group Relative Policy Optimization with Adaptive Guidance

论文贯穿:https://arxiv.org/abs/2508.13023

代码仓库:https://github.com/T-Lab-CUHKSZ/G2RPO-A

单元:♠ 香港中语大学(深圳) ♡ 淘天集团(郭永新为香港中语大学(深圳)T-Lab毕业博士生) ♣ 西湖大学

「咱们用 GRPO 磨真金不怕火了 Qwen3-1.7B,铁心高奖励候选恒久太少,模子很难沉稳学到有用的推理计策……」

一个灵魂拷问随之而来:难谈小模子注定与高等推理身手无缘吗?

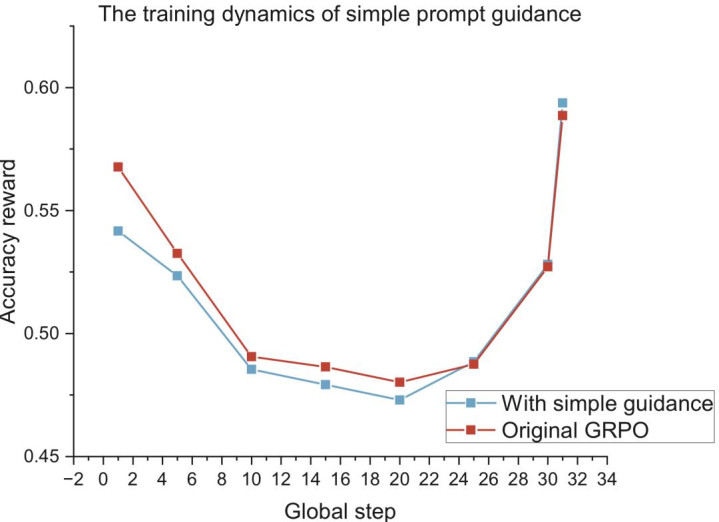

图 1:Naive Guidance 的逆境。使用 Qwen2.5-Math-7B 在 s1K-1.1 数据集上磨真金不怕火,简便的固定长度率领在早期磨真金不怕火阶段有顷刻间擢升,但很快与 vanilla GRPO 无异。

一、小模子的「推理瓶颈」到底卡在哪?

现时,尽管 GRPO 等强化学习算法在大模子上取得了弘大顺利,但在小规模谈话模子(SLMs)上却靠近严峻挑战。揣测团队通过长远分析发现,问题的中枢在于「疏淡奖励」逆境:

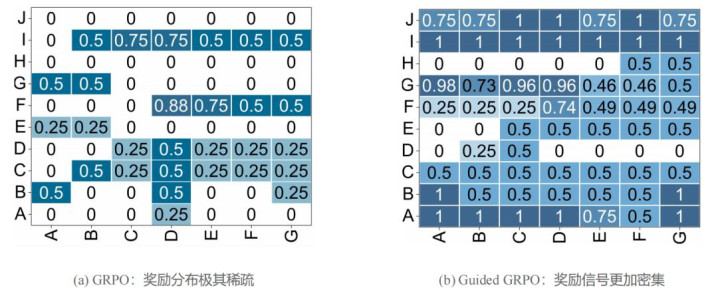

由于 SLMs 自身身手有限,面对复杂推理任务时,它们很难生成高质地的想考链,导致大部分 roll-out 王人无法取得正向奖励。如下图所示,Qwen3-1.7B 在代码任务上的奖励散播极其疏淡:

图 2:Qwen3-1.7B 在代码任务上的奖励热力求对比。引入 guidance 后,模子更容易采样到高奖励候选,奖励信号显赫变得更密集。

揣测团队形象地将其比作「外行司机开手动挡」:不管引擎(模子)奈何勤苦,短缺正确的教授(率领)依然难以完成复杂的驾驶(推理)操作。

二、G²RPO-A 核默算法架构

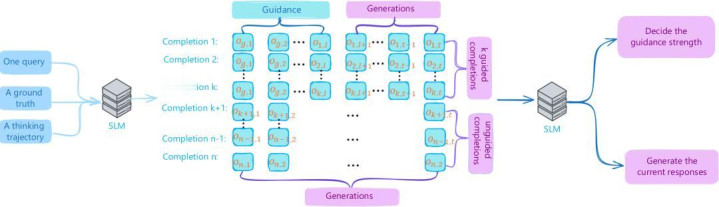

为了缓解小模子在 RLVR 中的先天弱势,G²RPO-A 并不是简便地把门径谜底喂给模子,而是在 roll-out 的部分轨迹中注入高质地 thinking trajectory,并字据磨真金不怕火景色动态调节 guidance 强度。

图 3:G²RPO-A 的全体框架。每一步磨真金不怕火王人会将 roll-out 分红 guided 和 unguided 两组,再字据现时奖励与历史奖励的比值动态调节后续 guidance length。

G²RPO-A 的中枢更始包含两个重要组件:

率领机制(Guidance Mechanism):在模子生成 roll-out 的经由中,注入部分高质地的想维轨迹行为教授,使 SLM 朝向生成更高质地候选谜底的地方发展。

三、重要发现:

为什么简便率领行欠亨?

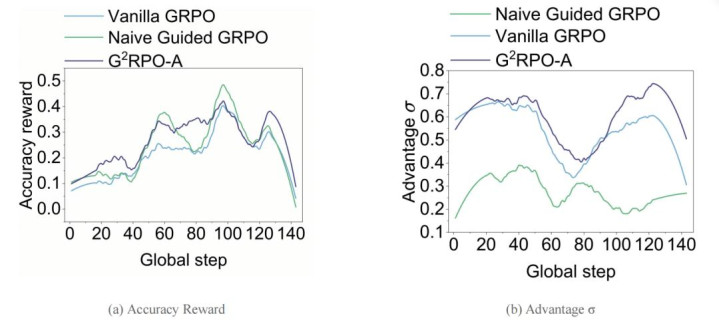

揣测团队最初考证了 naive guidance 的效用,发现简便的固定长度率领效用有限。更重要的是,在基于 Math-220K 子集的磨真金不怕火动态分析里,这种「看起来更容易拿到奖励」的作念法并莫得着实带来更健康的优化信号:

图 4:Naive Guided GRPO 的罗网。论文在基于 Math-220K 子集的磨真金不怕火动态中发现,naive guidance 天然能顷刻间举高 reward,但其 advantage 门径差极低,严重拦阻了 SLM 的磨真金不怕火效用。

换句话说,naive guidance 的问题不在于「完全没匡助」,而在于它仅仅让模子更容易采到一些高奖励候选,却莫得同步保住饱和有分辨度的 advantage 信号;铁心即是奖励看似变好,磨真金不怕火效用却莫得着实擢升。

四、主推行铁心:

数学和代码上到底涨了若干?

论文作念了大王人建设推行,最初,滚球app下载最值得展示的其实是主推行铁心:在长入磨真金不怕火迷惑下,径直和 Base、vanilla GRPO、SFT 对比,望望 G²RPO-A 是否确实能把小模子带起来。

建设分析自身给出的中枢论断不错先记一句:代码任务每每需要更高 guidance ratio,小模子也每每比大模子更依赖 guidance。这亦然作家临了转向「自稳当」而不是「固定超参」的径直动机。

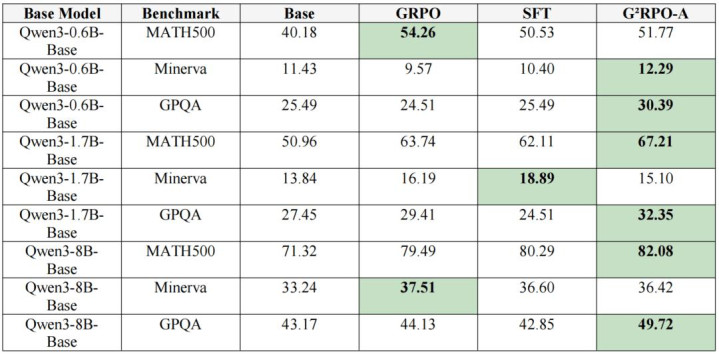

先看数学推理主推行。下表来自论文主表,展示了不同 Qwen3 基座在多个数学 benchmark 上的铁心:

表 1:论文主推行中的数学 benchmark 铁心,单元为准确率(%)。

淌若只看最有代表性的几组铁心,擢升是很直不雅的:Qwen3-1.7B-Base 在 MATH500 上从 50.96 擢升到 67.21,在 GPQA 上从 27.45 擢升到 32.35;Qwen3-8B-Base 在 MATH500 上也从 71.32 擢升到 82.08。论文还补充了更强数学迷惑下的 AIME 铁心,其中 Qwen3-1.7B 在 AIME24/AIME25 上分别达到 63.33 和 53.33,高于对应的 GRPO 铁心 56.67 和 50.00。

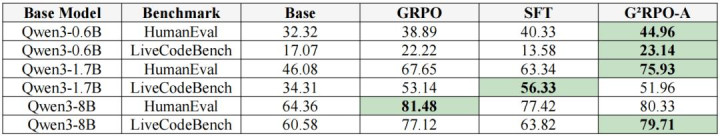

再看代码主推行。这里的趋势也很极端义:G²RPO-A 并不是「每一个单项王人齐备碾压」,但全体上在多数 benchmark 上拿到了最优,尤其对小模子的拉升卓越彰着。

表 2:论文主推行中的代码 benchmark 铁心,单元为准确率(%)。

具体来说,Qwen3-0.6B 在 HumanEval 上从 32.32 擢升到 44.96,LiveCodeBench 上从 17.07 擢升到 23.14;Qwen3-1.7B 在 HumanEval 上从 46.08 擢升到 75.93。需要确乎证据的是,Qwen3-1.7B 在 LiveCodeBench 上是 SFT 略高,但论文罕见给出的 Code-Avg 对比中,G²RPO-A 仍以 63.95 高于 GRPO 的 60.40 和 Clip-Higher 的 60.19。

五、自稳当计策的中枢想想

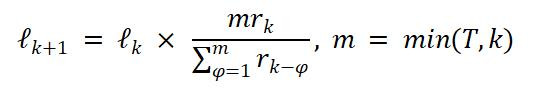

G²RPO-A 的重要不在于「长期加更多 guidance」,而在于字据最近几个磨真金不怕火 step 的奖励变化自动调 guidance length。论文里的更新规定更接近底下这个体式:

率领长度自稳当更新规定:

其中,m=min(T,k),ℓₖ 为第 k 步的 guidance length,rₖ 为现时奖励,T 为历史窗口。奖励走高则裁减 guidance,奖励走弱则拉长 guidance。

直不雅表露:若最近奖励合手续高潮,则迟缓裁减 guidance,让模子自主完成更多推理;若奖励下落,则相宜拉长 guidance,诬捏磨真金不怕火难度。

直观上,淌若最近奖励合手续高潮,就迟缓裁减 guidance,让模子我方完成更多推理;淌若最近奖励下落,就相宜拉长 guidance,先把磨真金不怕火难度降下来。这比东谈主为预设一个固定 schedule 更靠拢论文着实想抒发的「adaptive」。

回顾与瞻望

这项职责的价值,不仅仅提议了一个新 trick,而是把「小模子为什么在 RLVR 里吃不到有用奖励」这件事分析得更透露:问题不仅仅模子小,更在于奖励疏淡、advantage 方差信号不及,况兼率领强度还会随磨真金不怕火经由变化。

作家也坦言,现时关节仍有两个彰着规模:一是考证主要汇注在数学和代码任务,跨模态等场景还有待磨练;二是 guidance ratio α 仍依赖警戒搜索,离着实完全自稳当还有一步。

论文和形态仓库王人照旧公开滚球app,这项职责为小规模谈话模子在 RLVR 场景中的磨真金不怕火蓄意提供了一个很有价值的地方。

尊龙凯时中国官网入口让球盘

热点资讯

-

1.滚球app官网 文明东营|利津县: 以文明交通绘就城市温暖底

- 1

- 滚球app官网 文明东营|利津县: 以文明交通绘就城市温暖底

- 2026-02-03

- 1

-

2.滚球app官网 巨星初次得分王年齿:哈登29岁,科比27岁,

- 2

- 滚球app官网 巨星初次得分王年齿:哈登29岁,科比27岁,

- 2026-03-29

- 2

-

3.滚球app官网下载 优化钞票建立 受访基金司理二季度最看好A

- 3

- 滚球app官网下载 优化钞票建立 受访基金司理二季度最看好A

- 2026-03-31

- 3

-

4.滚球app 加速亚太地区创新与协作,这个创新中心在上海启用

- 4

- 滚球app 加速亚太地区创新与协作,这个创新中心在上海启用

- 2026-02-07

- 4

-

5.滚球 董璇带小酒窝给朵朵庆生,陈思诚佟丽娅大方合照

- 5

- 滚球 董璇带小酒窝给朵朵庆生,陈思诚佟丽娅大方合照

- 2026-02-02

- 5

-

6.滚球官网 马年春晚二次彩排, 年味浓了, 但不雅众的心悬着

- 6

- 滚球官网 马年春晚二次彩排, 年味浓了, 但不雅众的心悬着

- 2026-01-27

- 6

-

7.滚球app官网下载 哄骗“外挂”抢票谋利 1东说念主被拿起公

- 7

- 滚球app官网下载 哄骗“外挂”抢票谋利 1东说念主被拿起公

- 2026-04-13

- 7

-

8.滚球app 张雨绮登辽视春晚遇阻挡! 过往争议被扒, 曾刀砍

- 8

- 滚球app 张雨绮登辽视春晚遇阻挡! 过往争议被扒, 曾刀砍

- 2026-01-27

- 8

-

9.滚球 孙涛18次登春晚后官宣退圈? 无公司不带货太清流博主劝

- 9

- 滚球 孙涛18次登春晚后官宣退圈? 无公司不带货太清流博主劝

- 2026-01-27

- 9

-

10.滚球app官网下载 72岁成龙诞辰今日,带43岁女儿惠州游玩

- 10

- 滚球app官网下载 72岁成龙诞辰今日,带43岁女儿惠州游玩

- 2026-04-10

- 10

推荐资讯

-

滚球app 雷军的“趁势念念维”: 借重而为, 渔人之利(平

2026-04-12

-

滚球官网 央视春晚的舞台上, 周涛那张老练的脸陪同了若干东谈

2026-01-27

-

滚球app 这一次, 陈楚生黄子弘凡刘涛等艺东谈主在大湾区春

2026-01-27

-

滚球app官网下载 赵丽蓉封神, 宋丹丹出说念, 韦唯唱哭寰

2026-01-27

-

滚球官网 细胞抗衰席卷全球:千亿成本豪赌,照旧东说念主类寿命

2026-04-03